← 홈으로

YouTube2026-03-05

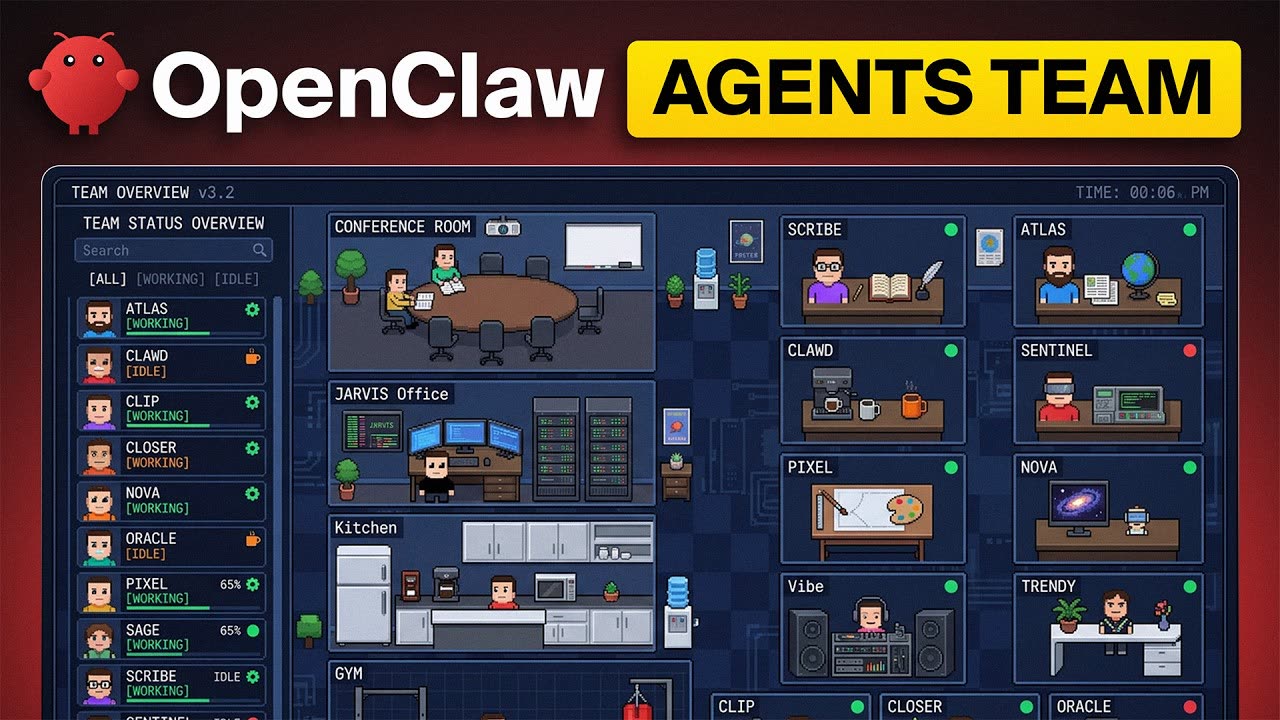

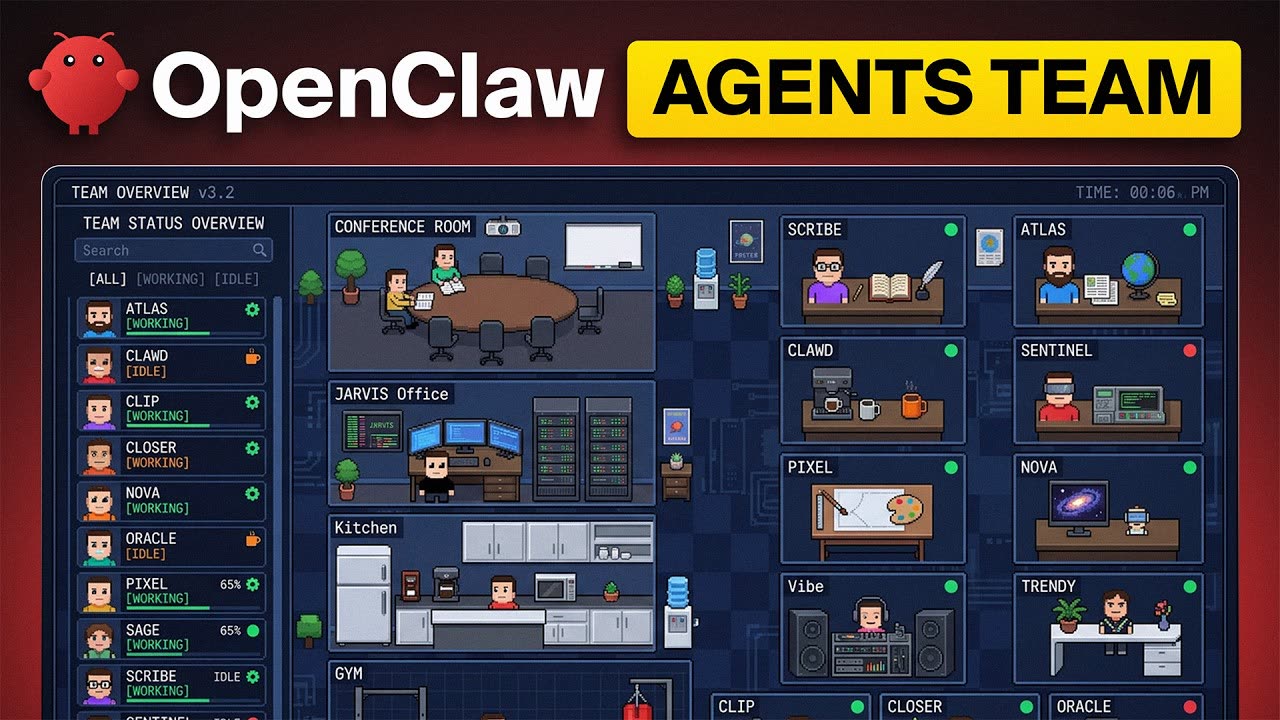

I Built a Full AI Team Inside OpenClaw for $400/Month

링크: https://youtu.be/4HyNQe6UI c?si=I0Ms2AvncqzbTwGA

원문/원본: https://youtu.be/4HyNQe6UI_c기존 공개 버전: pogovet.com

🎬 I Built a Full AI Team Inside OpenClaw for $400/Month

▶️ 유튜브

🖼️ 4컷 인포그래픽

💡 한 줄 결론

AI 에이전트 운영의 승부처는 에이전트 수가 아니라 저비용 모델 조합, cron 자동화, 작성-리뷰-보안 분업, 메모리·라우팅 가시화를 묶어 실제 기능 개선과 고객 획득으로 연결하는 운영 시스템이다. OpenClaw는 소규모 팀의 레버리지를 크게 늘리지만, 성과는 결국 도구가 아니라 맥락 설계와 워크플로우 구조에서 나온다.

📌 핵심 요점

- 월 약 400달러 안에서 Claude Max, GLM, Grok, Higgsfield, X API, Firecrawl 등을 역할별로 분산 배치해 15~16개 세션을 굴리며 비용 대비 생산성을 맞췄다.

- 밤 11시 코드베이스 점검 cron이 홈페이지 FAQ 누락을 찾아 PR까지 올렸고, 이 경험이 “자는 동안 제품이 개선되는 운영”의 실증 사례가 됐다.

- 개발 조직은 작성 담당, 코드 리뷰 담당, 보안 필터, 추가 LLM 검토를 분리해 단순 병렬 처리보다 품질 통제와 실패 방어에 초점을 맞췄다.

- Reddit·X 리서치와 카피 초안 생성을 잇는 파이프라인으로 450명 이상 유입과 첫 유료 사용자 확보까지 연결되며, 콘텐츠 자동화가 실제 획득 채널로 작동했다.

- 미션 컨트롤의 핵심은 화려한 사무실 UI가 아니라 메모리 파일, 규칙, 프롬프트, API 라우팅, 작업 상태를 사람이 즉시 점검·수정할 수 있게 만드는 운영 가시화 계층이다.

🧠 상세 요약

1) 배경과 문제 정의

이 영상의 출발점은 “AI 에이전트를 많이 띄우는 것”이 아니라, 비기술 창업자도 반복 업무·제품 개선·고객 획득을 실제 운영 시스템으로 묶을 수 있느냐는 질문이다. 따라서 봐야 할 포인트는 세 가지다: 비용 구조가 지속 가능한지, 역할 분리가 품질을 높이는지, 자동화가 실제 매출과 기능 개선으로 이어지는지다.

2) 섹션별 상세 정리

- 비기술 창업자가 AI 운영 체계에 올인한 출발점 [00:00]

- 빔은 18세, 비전공, 비개발 배경에서 출발했지만 낮에는 마케팅 직무를 하고 저녁에는 자신의 스타트업 Bugola를 운영하는 이중 구조를 유지한다.

- 핵심 메시지는 “기술 경험이 거의 없어도 운영 설계만 제대로 하면 AI 에이전트를 회사 레버리지로 쓸 수 있다”는 점이다.

- OpenClaw를 단순 챗봇이 아닌 실무 엔진으로 본 순간 [01:03]

- OpenClaw를 처음 본 계기는 유튜브였지만, 빔이 깊게 빠진 이유는 대화형 도구가 아니라 실제 일을 대신 처리하는 구조를 만들 수 있다는 가능성 때문이었다.

- 이 시점부터 관심사는 모델 성능 자체보다 “반복 업무를 누가 어떤 규칙으로 대신할 것인가”로 이동한다.

- 월 400달러 예산 안에서 짠 모델 조합 전략 [01:54]

- 총비용은 대략 월 400달러 수준이며, 약 250달러는 Claude Max, 나머지는 API 토큰·X API·Firecrawl 등 외부 도구 비용으로 배분된다.

- 중요한 점은 최고급 모델 일변도가 아니라, 고성능 모델은 코딩·핵심 작업에, 저가 모델은 리서치·초안·정찰에 쓰는 식으로 작업별 최소 충분 성능을 맞췄다는 것이다.

- 부서별 도구 배치와 “싼 모델 + 비싼 모델” 혼합 운영 [03:08]

- 영상·이미지·모션·개발·카피·트렌드 정찰을 각각 다른 모델과 API에 연결해, 모든 작업을 동일한 스택으로 처리하지 않는다.

- 예를 들어 카피에는 GLM 5, 트렌드 정찰에는 GLM 4.7, 개발에는 Claude Code와 Codex, 비디오 관련에는 Higgsfield·Grok 등을 조합해 비용과 성능을 함께 최적화한다.

- 첫 번째 개발 에이전트와 병렬 작업의 발견 [05:12]

- API, GitHub, IDE, 터미널 개념도 거의 모르던 상태에서 빔은 가장 먼저 코딩 에이전트를 붙여 실제 작업을 시켰다.

- 여기서 얻은 통찰은 AI가 단일 답변 생성기가 아니라 코드 작성, 자료 조사, 검토, 보안 점검을 병렬로 나눌 수 있는 작업 조직이 될 수 있다는 점이었다.

- 첫 실전 성과는 ‘밤 11시 cron이 만든 FAQ PR’이었다 [06:46]

- 이미 MVP는 있었지만, 빔은 매일 밤 코드베이스를 점검하고 필요한 기능을 제안·구현하는 cron 작업을 추가했다.

- 그 결과 홈페이지에 빠져 있던 FAQ 섹션이 자동 제안·구현돼 PR로 올라왔고, 이는 자동화가 단순 데모가 아니라 제품 개선 루프로 들어올 수 있음을 보여준 첫 사례가 됐다.

- “자는 동안 기능이 추가됐다”는 경험이 운영 철학을 바꿨다 [08:01]

- 빔은 처음엔 실패를 예상했지만, 다음 날 아침 실제 PR이 도착한 것을 보고 자동화의 실전 가능성을 체감했다.

- 이 경험 이후 방향은 명확해졌다. 한두 개 보조 도구가 아니라, 야간에도 제품과 운영이 계속 움직이는 상시 회사 구조를 만들겠다는 쪽으로 확신이 커졌다.

- 여러 대의 장비보다 하나의 인스턴스 안 역할 세션 증식이 핵심이다 [09:09]

- 빔은 여러 맥 미니를 늘리는 방식보다, 한 대의 맥 미니 위 OpenClaw 인스턴스에서 다수의 세션과 서브에이전트를 분리 운용하는 방식을 택했다.

- 즉 확장의 단위가 하드웨어 증설이 아니라 역할 세분화된 세션 설계라는 점이 중요하다.

- 미션 컨트롤의 진짜 의미는 UI가 아니라 운영 가시화다 [10:53]

- 미션 컨트롤은 멋진 사무실 화면 자체보다, 에이전트 상태·메모리 파일·프롬프트·규칙·라우팅 로직을 한눈에 볼 수 있게 만든 인터페이스다.

- 사람이 언제든 내부 문맥을 열어보고 수정할 수 있어야 자동화가 블랙박스가 아니라 관리 가능한 시스템이 된다는 관점이 드러난다.

- 메모리·규칙·라우팅 파일이 실제 운영체제 역할을 한다 [11:59]

- 각 에이전트는 MD 파일, 규칙, 프롬프트, API 키 연결 방식 등으로 관리되며, 이 조합이 사실상 회사의 운영 로직을 이룬다.

- 중요한 것은 에이전트에게 일을 “부탁”하는 것이 아니라, 어떤 입력이 들어왔을 때 어떤 역할이 어떤 도구와 키를 써서 어떤 산출물을 내는지 명시적으로 설계해 둔다는 점이다.

- 핵심 에이전트들은 회사의 실제 직무 단위를 복제한다 [13:22]

- Jarvis는 메인 운영 및 라우팅, Alice는 리서치, Scribe는 카피, Trendy는 트렌드 정찰, Sentinel은 버그·코드 감시, Clip은 클리핑 제품 실행을 맡는다.

- 이 구조는 AI를 “한 명의 만능 비서”로 쓰지 않고, 직무별 전문 셀로 쪼개 운영하는 형태에 가깝다.

- 리서치-카피-수동 게시 파이프라인이 실제 고객 획득으로 이어졌다 [14:34]

- Alice가 Reddit과 X에서 경쟁사 불만, 추천 글, 바이럴 패턴을 수집하고, Scribe가 이를 바탕으로 답글·게시 초안을 만든다.

- 빔은 최종 게시만 직접 수행했고, 그 결과 450명 이상 유입과 첫 유료 사용자 확보까지 이어졌다. 즉 자동화의 성과 측정 기준이 조회수가 아니라 사용자 증가와 결제 전환으로 제시된다.

- 24시간 회사 운영의 핵심은 개별 cron들의 조합이다 [16:28]

- 연구, 초안 작성, 트렌드 정찰, 시스템 감시, 클리핑 등 각 기능은 서로 다른 주기로 개별 cron 작업으로 돌아간다.

- 이 구조 덕분에 메인 에이전트는 라우팅과 의사결정 중심에 남고, 반복 작업은 각자 다른 빈도로 돌아가는 반자동 조직으로 분산된다.

- 같은 부서의 여러 에이전트는 중복이 아니라 검토 체계다 [17:50]

- 개발팀 안에서 작성자, 리뷰어, 보안 필터, 추가 검수자가 따로 존재하는 이유는 생산성보다 품질 통제 때문이다.

- 빔은 단일 에이전트가 처음부터 끝까지 다 처리하는 구조보다, 작성-리뷰-보안 검수 분리가 실제 운영 안정성에 더 중요하다고 본다.

- 화려한 데모와 진짜 운영 사례를 구분해야 한다 [22:58]

- 빔은 OpenClaw 관련 콘텐츠 중 상당수가 바이럴용 전시라고 보며, 진짜 사례는 워크플로우·메모리 시스템·프롬프트 구조·토큰 사용량까지 드러내는 운영형 사례라고 구분한다.

- 결론적으로 AI 에이전트는 “설치하면 저절로 돌아가는 마법”이 아니라, 충분한 맥락 입력과 프롬프트 설계, 역할 정의가 있어야 성과가 나는 시스템이라는 점을 강조한다.

- 초보자에게 필요한 것은 미션 컨트롤 기술보다 자기 맥락 정리다 [24:46]

- 빔은 처음 1~2일 동안 자신의 정체성, 비즈니스, 업무 방식, 원하는 회사 구조를 먼저 정리하라고 조언한다.

- 좋은 결과는 어떤 UI 빌더를 쓰느냐보다, 에이전트에게 얼마나 풍부한 맥락과 구체적인 요구사항을 넘기느냐에 달려 있다는 것이다.

- 장기 비전은 ‘직원 채용’보다 ‘에이전트 회사 운영자 채용’이다

- 빔은 앞으로 개발자 한 명을 채용하기보다, 이미 하나의 OpenClaw 조직을 운영할 줄 아는 사람을 통째로 영입하는 식의 확장을 상상한다.

- 이는 AI 에이전트가 단순 보조 도구를 넘어, 창업자 1명이 훨씬 큰 조직 레버리지를 확보하게 해주는 회사 운영 인프라가 될 수 있다는 믿음으로 이어진다.

✅ 액션 아이템

- 현재 업무를 개발, 리서치, 카피, 모니터링, 배포, 고객획득의 6개 역할로 분해하고, 각 역할마다 사용할 모델 1순위·백업 모델·월 허용비용 상한을 정해 역할별 모델 라우팅표를 만든다.

- 제품 코드베이스나 운영 문서에 대해 매일 밤 1회 실행되는 cron 점검 작업을 설계해, 누락 기능 탐지 → 변경 제안 → 초안 PR 또는 작업 티켓 생성까지 자동으로 남기게 한다.

- 메인 라우터 1개, 리서처 1개, 작성자 1개, 감시자 1개로 시작하는 최소 조직을 만들고, 각 에이전트의 입력 파일·출력 형식·실행 주기·승인 필요 구간을 문서화한다.

- Reddit 또는 X 중 한 채널을 골라 경쟁사 불만 글, 추천 글, 자주 반복되는 질문을 2주간 수집하게 하고, 이를 기반으로 답글 초안을 생성해 실제 전환률과 유입 수를 측정한다.

- 미션 컨트롤 요구사항을 “예쁜 UI”가 아니라 운영 가시화 기준으로 다시 정의해, 에이전트 상태·최근 실행 로그·메모리 파일·규칙 파일·크레딧 사용량·실패 알림을 한 화면에서 확인할 수 있게 설계한다.

❓ 열린 질문

- Reddit에서 나온 450명 이상 유입은 에이전트 구조의 우위인가, 아니면 채널 선택과 수동 게시 타이밍의 우위인가? 같은 구조를 다른 SaaS 카테고리에서도 재현할 수 있는지 검증이 필요하다.

- 월 400달러 운영비는 저가 모델 혼합과 상대적으로 작은 작업량을 전제로 하는데, 기능 수와 세션 수가 두 배 이상 늘어나면 어느 지점에서 리뷰 비용과 토큰 비용이 급격히 증가할까?

- FAQ처럼 저위험 기능은 야간 자동 PR이 유효하지만, 결제·권한·보안 로직까지 자동화 범위를 넓힐 경우 작성-리뷰-보안 분리가 실제로 어느 수준까지 리스크를 흡수할 수 있을까?

- “OpenClaw 회사 운영자”를 채용하는 모델이 현실화되려면, 각 운영자의 프롬프트·메모리·규칙 체계를 다른 회사 환경에 이식할 때 보안 경계와 지식 이전 비용을 어떻게 표준화해야 할까?